فرضیه اصلی در رگرسیون خطی چندگانه این است که وابستگی متغیر وابسته به متغیرهای مستقل به صورت یک رابطه خطی است که توسط ضرایبی که به آنها "ضرایب رگرسیون" میگویند، تعیین میشود. در واقع، مدل رگرسیون خطی چندگانه به دنبال پیدا کردن یک خط است که بهترین تطابق را بین مقادیر واقعی متغیرهای مستقل و وابسته فراهم میکند. برای آموزش مدل رگرسیون خطی چندگانه، از روش کمترین مربعات استفاده میشود. این روش سعی میکند مجموع مربعات خطاها (فاصله بین مقادیر واقعی و پیشبینی شده) را کمینه کند و بدین ترتیب خطی را پیدا کند که بهترین تطابق را بین دادهها و مدل فراهم میکند.

یکی از مزایای رگرسیون خطی چندگانه این است که میتواند تأثیر متغیرهای مستقل را به صورت مستقل از یکدیگر اندازهگیری کند و تأثیر هر متغیر را بر روی متغیر وابسته برآورد کند. همچنین، مدل رگرسیون خطی چندگانه قابلیت تفسیرپذیری بالا دارد، به این معنی که میتوانیم براساس ضرایب رگرسیون، تأثیر هر متغیر مستقل را بر روی متغیر وابسته تفسیر کنیم.

به عنوان مثال، فرض کنید میخواهیم قیمت یک خانه را بر اساس ویژگیهایی مانند متراژ، تعداد اتاقها، مکان و... پیشبینی کنیم. در این صورت، رگرسیون خطی چندگانه میتواند استفاده شود تا مدلی را برای پیشبینی قیمت خانه استفاده کند. با استفاده از دادههای آموزشی که شامل قیمت و ویژگیهای متغیرهای مستقل است، مدل رگرسیون خطی چندگانه میتواند ضرایب رگرسیون را بدست آورده و با استفاده از آنها، قیمت خانه را بر اساس ویژگیهای ورودی پیشبینی کند. با توجه به توضیحاتی که ارائه کردیم باید بگوییم که رگرسیون خطی چندگانه یک ابزار قدرتمند در تحلیل رابطه بین متغیرها است و به عنوان یک روش پیشبینی و تفسیر روابط، در بسیاری از حوزهها مورد استفاده قرار میگیرد، از جمله علوم اجتماعی، علوم رفتاری، علوم طبیعی و مهندسی.

مدل رگرسیون خطی

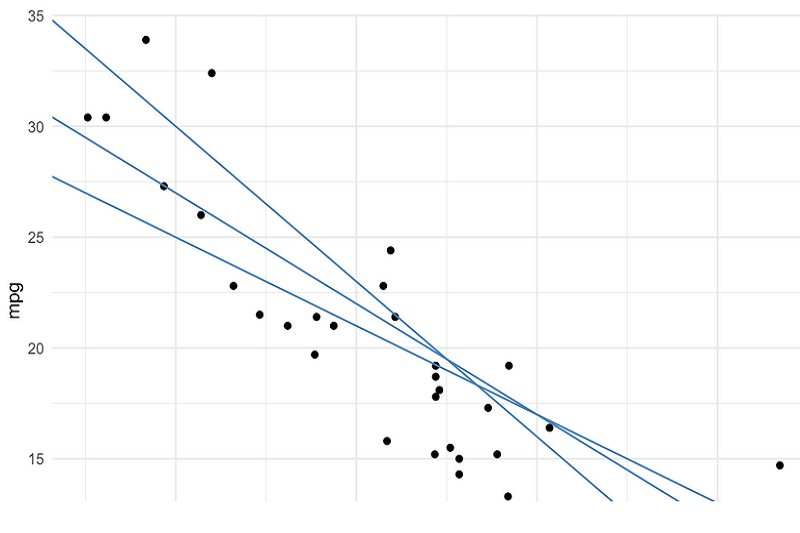

مدل رگرسیون خطی یک مدل آماری است که برای تخمین و پیشبینی متغیر وابسته (یا متغیر پاسخ) بر اساس یک یا چند متغیر مستقل (یا ویژگیها) استفاده میشود. در این مدل، فرض میشود که رابطه بین متغیرهای مستقل وابسته خطی است، به این معنی که تغییر در هر یک از متغیرهای مستقل به صورت مستقیم و خطی بر متغیر وابسته تأثیر میگذارد. در مدل رگرسیون خطی، متغیر وابسته (Y) به عنوان متغیر وابسته و متغیرهای مستقل (X₁, X₂, ..., Xₖ) به عنوان متغیرهای وابسته در نظر گرفته میشوند. مدل رگرسیون خطی تلاش میکند تا ضرایب (β₀, β₁, β₂, ..., βₖ) را بیابد که بهترین تطابق را بین دادههای واقعی و پیشبینی شده فراهم میکند. مدل رگرسیون خطی میتواند به صورت ریاضی به صورت زیر بیان شود:

Y = β₀ + β₁X₁ + β₂X₂ + ... + βₖXₖ + ε

در این معادله، Y نشان دهنده متغیر وابسته است و (X₁, X₂, ..., Xₖ) متغیرهای مستقل (ویژگیها) هستند. β₀ تعیین کننده ترم ثابت و β₁ تا βₖ ضرایب رگرسیون هستند که نشان میدهند چقدر تأثیر مستقیم و خطی هر یک از متغیرهای مستقل بر متغیر وابسته است. ε نشان دهنده خطا یا تفاوت بین پیشبینی مدل و مقادیر واقعی متغیر وابسته است. برای آموزش مدل رگرسیون خطی، از روش کمترین مربعات استفاده میشود. هدف این روش، کمینه کردن مجموع مربعات خطاها بین مقادیر واقعی و پیشبینی شده است. با استفاده از این روش، مقادیر بهینه برای ضرایب رگرسیون β₀ تا βₖ محاسبه میشوند.

مزیت اصلی مدل رگرسیون خطی این است که مدل راحتتر قابل تفسیر میکند. به عنوان مثال، با تأمل در ارزش مطلق و علامت ضرایب رگرسیون، میتوان تأثیر هر متغیر مستقل را بر روی متغیر وابسته تفسیر کرد. همچنین، مدل رگرسیون خطی قابلیت توسعه و تعمیم به رگرگرسیون خطی ساده است که تنها یک متغیر مستقل را در نظر میگیرد. این مدل به صورت زیر بیان میشود:

Y = β₀ + β₁X + ε

در اینجا، Y نشان دهنده متغیر وابسته است، X نشان دهنده متغیر مستقل است و β₀ و β₁ ضرایب رگرسیون هستند. β₀ ترم ثابت را نشان میدهد و β₁ ضریب رگرسیون است که نشان میدهد تا چه اندازه تغییر در متغیر مستقل تغییر در متغیر وابسته را توصیف میکند. ε نشان دهنده خطا یا تفاوت بین پیشبینی مدل و مقادیر واقعی متغیر وابسته است. مدل رگرسیون خطی چندگانه، به عنوان یک نسخه پیشرفته از رگرسیون خطی ساده شناخته میشود که برای بررسی رابطه بین یک متغیر وابسته و دو یا بیشتر متغیر مستقل استفاده میشود. در هر دو مدل رگرسیون خطی ساده و چندگانه، هدف استفاده از روش کمترین مربعات است که مقادیر بهینه برای ضرایب رگرسیون را محاسبه میکند و مدل را برای پیشبینی و تحلیل استفاده میکند.

بردار مشاهدات متغیر پاسخ

بردار مشاهدات متغیر پاسخ یا بردار وابسته (Y)، مجموعهای از مقادیر مشاهدات واقعی متغیر پاسخ در یک مجموعه داده است. این بردار، معمولاً با نماد Y بیان میشود و برای تحلیل و استفاده در مدلهای آماری مانند رگرسیون خطی استفاده میشود. برای مثال، فرض کنید که شما یک مطالعه انجام دادهاید تا تأثیر سن، تحصیلات و سابقه کار بر درآمد افراد را بررسی کنید. در این صورت، بردار مشاهدات متغیر پاسخ (Y) میتواند شامل درآمدهای واقعی افراد مورد بررسی در مجموعه داده شما باشد. برای مثال، اگر شما اطلاعات ۱۰ نفر را داشته باشید، بردار مشاهدات متغیر پاسخ (Y) میتواند به صورت زیر باشد:

Y = [4500, 6000, 5500, 7000, 8000, 4000, 7500, 6500, 5000, 5500]

در اینجا، هر عضو از بردار Y نشاندهنده درآمد واقعی یک فرد در مجموعه داده است. با استفاده از این بردار، میتوانید مدل رگرسیون خطی را آموزش دهید و با استفاده از ضرایب به دست آمده، میزان تأثیر سن، تحصیلات و سابقه کار را بر روی درآمد پیشبینی کنید.

ماتریس متغیرهای مستقل

ماتریس متغیرهای مستقل یا ماتریس X، مجموعهای از مشاهدات واقعی متغیرهای مستقل در یک مجموعه داده است. معمولاً با نماد X نشان داده میشود و برای تحلیل و استفاده در مدلهای آماری مانند رگرسیون خطی استفاده میشود. اجازه دهید به مثال قبل بازگردیم. اگر شما برای یک مطالعه در زمینه تأثیر سن، تحصیلات و سابقه کار بر درآمد افراد، اطلاعات ۱۰ نفر را داشته باشید، ماتریس متغیرهای مستقل (X) میتواند شامل مقادیر واقعی این سه متغیر برای هر فرد باشد. به طور مثال، فرض کنید متغیرهای مستقل سن (X1)، تحصیلات (X2) و سابقه کار (X3) را با استفاده از مقادیر زیر نشان دهیم:

X = [[30, 14, 4],

[25, 16, 2],

[35, 12, 6],

[40, 18, 8],

[28, 15, 3],

[32, 13, 5],

[37, 16, 7],

[27, 14, 2],

[33, 17, 4],

[29, 15, 3]]

در اینجا، هر سطر از ماتریس X نشاندهنده سن، تحصیلات و سابقه کار یک فرد در مجموعه داده است. با استفاده از این ماتریس، میتوانید مدل رگرسیون خطی را آموزش دهید و با استفاده از ضرایب به دست آمده، تأثیر هر یک از متغیرهای مستقل بر درآمد را بررسی کنید.

بردار پارامترها

بردار پارامترها یا بردار ضرایب یا بردار θ، مجموعهای از مقادیر پارامترهای مدل است که توسط الگوریتمهای یادگیری ماشین برای تخمین مقدار متغیر پاسخ (Y) از متغیرهای مستقل (X) استفاده میشود. این بردار، معمولاً با نماد θ بیان میشود و از طریق فرآیند یادگیری با دادههای آموزش به دست میآید. در حالت کلی، اگر مدل خطی را در نظر بگیریم که تابع پیشبینی را به صورت زیر تعریف میکند:

Y = θ₀ + θ₁X₁ + θ₂X₂ + ... + θₚXₚ

که در آن Y متغیر پاسخ، X₁ تا Xₚ متغیرهای مستقل و θ₀ تا θₚ پارامترهای مدل هستند. بردار پارامترها (θ) در این حالت به صورت زیر تعریف میشود:

θ = [θ₀, θ₁, θ₂, ..., θₚ]

برای مثال، اگر مدل خطی دو متغیره را در نظر بگیریم که تابع پیشبینی را به صورت زیر تعریف میکند:

Y = θ₀ + θ₁X₁ + θ₂X₂

بردار پارامترها (θ) در این حالت به صورت زیر تعریف میشود:

θ = [θ₀, θ₁, θ₂]

مقادیر پارامترها (θ) با استفاده از الگوریتمهای یادگیری ماشین مانند رگرسیون خطی، رگرسیون لجستیک و غیره، از طریق فرآیند یادگیری و بهینهسازی با دادههای آموزش به دست میآیند. این پارامترها نقش مهمی در تبدیل متغیرهای مستقل به متغیر پاسخ پیشبینی شده دارند.

بردار خطا

بردار خطا یا بردار رزیدوال (Residual)، مجموعهای از اختلافات بین مقادیر واقعی متغیر پاسخ (Y واقعی) و مقادیر پیشبینی شده توسط مدل (Y پیشبینی شده) است. این بردار معمولاً با نماد e بیان میشود و برای ارزیابی عملکرد مدل پیشبینی در مسائل رگرسیون، استفاده میشود. برای مثال، اگر شما یک مدل رگرسیون خطی را بر روی یک مجموعه داده آموزشی آموزش دادهاید و میخواهید بردار خطا را محاسبه کنید، میتوانید از فرمول زیر استفاده کنید:

e = Y واقعی - Y پیشبینی شده

در اینجا، Y واقعی نشاندهنده مقادیر واقعی متغیر پاسخ در مجموعه داده است و Y پیشبینی شده نشاندهنده مقادیر پیشبینی شده توسط مدل است. هر عنصر از بردار خطا (e) نشاندهنده خطا یا اختلاف بین مقدار واقعی و مقدار پیشبینی شده برای یک نمونه از داده است. میتوانید بردار خطا را برای همه نمونهها در مجموعه داده محاسبه کرده و از معیارهای ارزیابی مانند میانگین مطلق خطا (MAE) یا میانگین مربعات خطا (MSE) برای ارزیابی کلی عملکرد مدل استفاده کنید.

برآورد پارامترهای مدل رگرسیون خطی

برآورد پارامترهای مدل رگرسیون خطی به معنای یافتن بهترین مقادیر برای پارامترها است که مدل خطی بهترین پیشبینی را برای متغیر پاسخ (Y) بر اساس متغیرهای مستقل (X) ارائه کند. یکی از روشهای معروف برای برآورد پارامترها در مدل خطی، استفاده از روش کمترین مربعات (Least Squares) است. در روش کمترین مربعات، میخواهیم مقادیر پارامترها (θ) را به دست آوریم که مجموع مربعات خطاها (مجموع مربعات بردار خطا) را کمینه کند. برای این منظور، باید یک تابع هدف (تابع خطا) تعریف کنیم که به ما اندازه خطا را میدهد و با استفاده از روش بهینهسازی، پارامترها را بهینه کنیم. یک مثال از تابع هدف معمول در رگرسیون خطی، میانگین مربعات خطا (MSE) است. برای برآورد پارامترها با استفاده از MSE، باید تابع خطا را به صورت زیر تعریف کنیم:

L(θ) = (1/n) * Σ(Y واقعی - Y پیشبینی شده)²

در اینجا، Y واقعی نشاندهنده مقادیر واقعی متغیر پاسخ در مجموعه داده است و Y پیشبینی شده نشاندهنده مقادیر پیشبینی شده توسط مدل است. θ نیز بردار پارامترهای مدل رگرسیون خطی است. سپس، میتوانید با استفاده از روش بهینهسازی مانند روش گرادیان کاهشی (Gradient Descent) یا روش معادلات نرمال (Normal Equations)، پارامترهای بهینه را برآورد کنید. در روش گرادیان کاهشی، با تکرار محاسبه خطا و بهروزرسانی پارامترها در جهت کاهش خطا، به مقادیر بهینه پارامترها میرسیم. در روش معادلات نرمال، با استفاده از رابطه آنالیتیک برای یافتن مشتق تابع هدف و قرار دادن آن مساوی با صفر، مقادیر بهینه پارامترها را محاسبه میکنیم. با برآورد پارامترهای مدل رگرسیون خطی، میتوانید از مدل برای پیشبینی مقادیر پاسخ جدید بر اساس مقادیر متغیرهای مستقل استفاده کنید.

فرضیات مدل رگرسیون خطی در تکنیک OLS

در روش کمترین مربعات (OLS) برای برآورد پارامترهای مدل رگرسیون خطی، ما از تعدادی فرضیه استفاده میکنیم. این فرضیات شامل موارد زیر میشوند:

- خطی بودن رابطه: فرض میکنیم که رابطه بین متغیرهای مستقل (X) و متغیر پاسخ (Y) به صورت خطی است. به عبارت دیگر، مدل رگرسیون خطی فرض میکند که تغییر در متغیرهای مستقل باعث تغییر خطی در متغیر پاسخ میشود.

- بی ارتباط بودن خطاها: فرض میکنیم که خطاها (اختلاف بین مقادیر واقعی و پیشبینی شده) بین نمونهها مستقل از یکدیگر هستند و هیچ رابطه سیستماتیکی با متغیرهای مستقل وجود ندارد. به عبارت دیگر، خطاها به طور میانگین صفر هستند و هیچ الگوی خاصی ندارند.

- همسانی واریانس خطاها: فرض میکنیم که واریانس خطاها (میزان پراکندگی خطاها) در تمام مقادیر مستقل یکسان است، یعنی واریانس خطاها ثابت است. این فرض به عنوان همسانی واریانس یا همسانی پراکندگی خطاها نامیده میشود.

- بدون چندخطی (Multicollinearity): فرض میکنیم که متغیرهای مستقل بین خود هیچ رابطه خطی معناداری ندارند. به عبارت دیگر، هیچ ترکیب خطی از متغیرهای مستقل وجود ندارد که باعث شود متغیر پاسخ به صورت دقیق توسط آن ترکیب قابل پیشبینی باشد.

این فرضیات در روش OLS مورد استفاده قرار میگیرند و با مطابقت آنها، میتوانیم پارامترهای بهینه مدل را برآورد کنیم و از مدل برای پیشبینی مقادیر پاسخ جدید استفاده کنیم. در صورتی که فرضیات بالا برقرار نباشند، نتایج بدست آمده از مدل ممکن است نادقیق یا ناقص باشند و به دقت پیشبینی تأثیر بگذارند.

ماهنامه شبکه را از کجا تهیه کنیم؟

ماهنامه شبکه را میتوانید از کتابخانههای عمومی سراسر کشور و نیز از دکههای روزنامهفروشی تهیه نمائید.

ثبت اشتراک نسخه کاغذی ماهنامه شبکه

ثبت اشتراک نسخه آنلاین

کتاب الکترونیک +Network راهنمای شبکهها

- برای دانلود تنها کتاب کامل ترجمه فارسی +Network اینجا کلیک کنید.

کتاب الکترونیک دوره مقدماتی آموزش پایتون

- اگر قصد یادگیری برنامهنویسی را دارید ولی هیچ پیشزمینهای ندارید اینجا کلیک کنید.

نظر شما چیست؟