فرض کنید خودرویی دچار نقص فنی شده است و قادر به توقف نیست و دو انتخاب داریم:

- یا با خودرو به عابران پیاده بزنیم و سرنشینان را نجات دهیم

- یا منحرف شویم و با کوبیدن خود به مانعی، متوقف شده و کشته شویم.

در مورد انسان چنین رویدادی، در کسری از ثانیه اتفاق میافتد و تصمیمگیری بسیار دشوار و حتی غیرممکن است. اما برای خودرانها که توان محاسباتی بالایی دارند این تصمیمی سرنوشتساز و حیاتی است. این پرسش بیش از آنکه فنی باشد، یک پرسش اخلاقی محسوب میشود و نمونههای مشابه آن قرنهاست که ذهن فلاسفه را درگیر کرده است. بطورکلی نظرات فلاسفه در زمینه دو راهیهای اخلاقی را میتوان در دو دسته جای داد.

- یک گروه موافق امانوئل کانت هستند. طبق نظر کانت، در چنین مواردی نباید کاری کنیم. باید اجازه داد خودرو به مسیرش ادامه دهد حتی اگر افراد بیشتری کشته شوند. به بیان دیگر، خودران نباید عامدانه کاری کند که کسی کشته شود.

- در سوی دیگر، جرمی بنتام ایستاده است. براساس نظر او، باید طوری انتخاب کرد که کمترین هزینه را در بر داشته باشد. به عبارت دیگر طبق نظر او، خودران باید طوری تصمیم بگیرد که تعداد کمتری کشته شوند حتی اگر لازم باشد سرنشین فدای بقیه گردد.

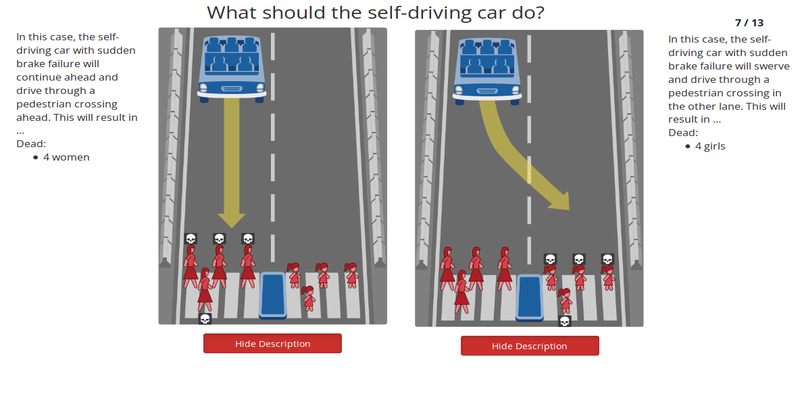

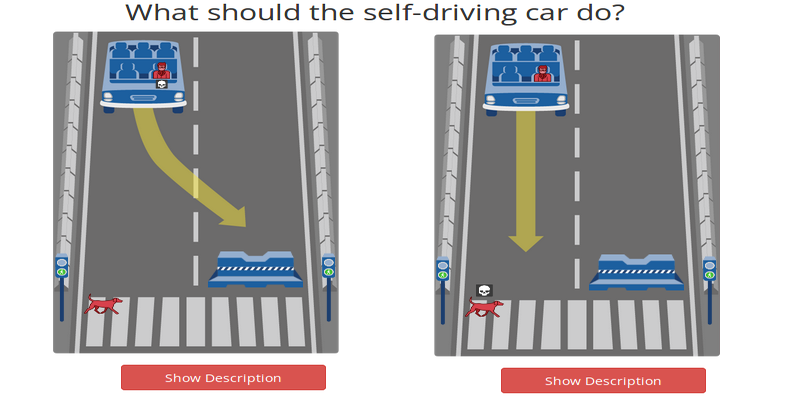

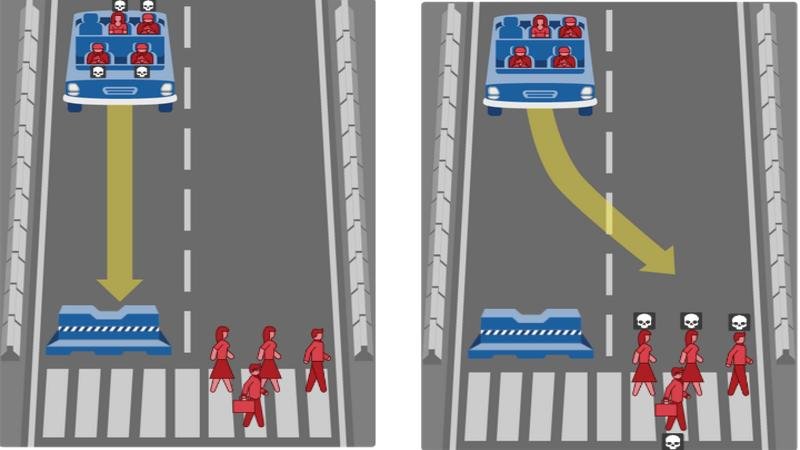

گروهی از محققان با به راه انداختن یک بررسی در قالب سایت Moral Machine از کاربران میخواهند خود را جای خودران قرار داده و تصمیم بگیرند. در این سایت سناریوهای مختلفی به کاربر ارایه میشود و کاربر بین گزینهها تصمیم میگیرد. محققان با استفاده از این وبسایت و با به چالش کشیدن کاربران، از آنها کمک میگیرند تا دریابند مردم در این دو راهیهای اخلاقی چه تصمیمی را انتخاب خواهند کرد؟

یکی از سناریوهای سایت Moral Machine. در اینجا باید تصمیم بگیرید که اگر بجای خودرانی بودید که دچار نقص فنی شده است کدام گزینه را انتخاب میکردید؟ جان کودکان را نجات میدادید یا جان چهار زن را؟

یکی دیگر از سناریوهای سایت Moral Machine

نتایج نظرسنجی این گروه نشان داد که اکثر مردم نظیر بنتام فکر میکنند اما زمانیکه از آنها سؤال میشود «آیا خودرویی را میخرید که عابران را به شما ترجیح میدهد؟» میگویند « قطعاً نمیخریم!» مردم خودرویی میخواهند که در چنین موقعیتهایی از آنها محافظت کند و در عین حال افراد کمتری کشته شوند! تناقضی که هم عجیب است و هم بسیار مهم.

نکته حایز اهمیت این است که انتخابهای کاربران سایت Moral Machine بستگی زیادی به فرهنگ و نوع زندگی و کشور آنها دارد.

همین هم باعث شده این ایده مطرح شود که سامانههای هوشمند مبتنی بر یادگیری ماشین باید بر اساس دادههایی آموزش داده شوند که سازگار با محیطی باشند که سامانه قرار است در آنجا استفاده شود. این مختص خودرانها نیست و حتی در مورد سامانههای هوشمند تشخیص پزشکی و یا نظامی هم صدق میکند.

ماهنامه شبکه را از کجا تهیه کنیم؟

ماهنامه شبکه را میتوانید از کتابخانههای عمومی سراسر کشور و نیز از دکههای روزنامهفروشی تهیه نمائید.

ثبت اشتراک نسخه کاغذی ماهنامه شبکه

ثبت اشتراک نسخه آنلاین

کتاب الکترونیک +Network راهنمای شبکهها

- برای دانلود تنها کتاب کامل ترجمه فارسی +Network اینجا کلیک کنید.

کتاب الکترونیک دوره مقدماتی آموزش پایتون

- اگر قصد یادگیری برنامهنویسی را دارید ولی هیچ پیشزمینهای ندارید اینجا کلیک کنید.

نظر شما چیست؟